Comment l’intelligence artificielle pense-t-elle ? Pourquoi elle agit davantage par intuition que par raisonnement

Aujourd’hui, des modèles comme ChatGPT, Claude ou Gemini accomplissent des tâches qui relevaient autrefois exclusivement des humains : rédiger des textes, programmer, traduire, comprendre un contexte ou analyser le contenu d’une image. Mais cela ne signifie pas qu’ils « pensent » comme nous.

Plus surprenant encore, leurs performances ne reposent pas toujours sur un raisonnement logique explicite. Elles s’appuient plutôt sur un mécanisme proche de l’intuition : ils apprennent à partir de millions d’exemples, puis agissent comme s’ils avaient compris la règle… sans jamais l’énoncer clairement.

Pour comprendre comment ces systèmes ont atteint un tel niveau, il faut revenir à une époque où la question était toute différente une machine peut-elle réellement penser ?

Dans les années 1950, il n’était pas question de modèles linguistiques géants ni de réseaux comptant des milliards de paramètres, mais d’une idée presque audacieuse pour son temps : construire une machine capable d’imiter la pensée humaine.

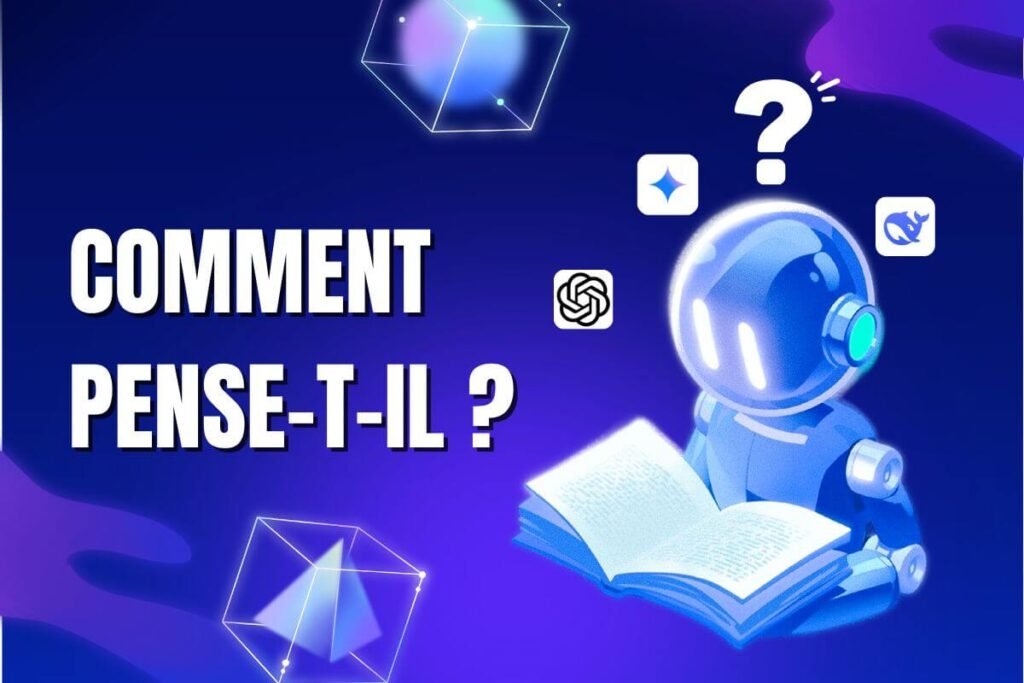

Au cours des décennies suivantes, les chercheurs ont exploré plusieurs pistes. Ils ont tenté d’écrire les règles à la main, de concevoir des systèmes fondés sur une logique explicite, de représenter la connaissance directement à l’intérieur de l’ordinateur. Mais cette approche a rapidement montré ses limites. Le monde est trop complexe pour être réduit à un ensemble de règles préécrites.

Dès lors, une nouvelle question s’est imposée : et si la machine pouvait apprendre ces règles directement à partir des données ?

Pourquoi maintenant ?

Trois éléments ont convergé : des algorithmes efficaces, une puissance de calcul massive et des quantités de données inédites. Derrière cette convergence, il y a aussi des trajectoires individuelles. Geoffrey Hinton continue de croire aux réseaux neuronaux quand beaucoup les abandonnent

Jensen Huang développe des puces parallèles bien au-delà des besoins du jeu vidéo. Fei-Fei Li constitue ImageNet, une base d’images gigantesque que certains jugent démesurée.

En 2012, AlexNet démontre la puissance de cette combinaison un réseau entraîné à grande échelle sur des GPU dépasse largement les performances précédentes en reconnaissance d’images.

Le message circule alors dans les laboratoires : cette approche fonctionne. Réseaux massifs, données massives, calcul massif.

Même si le développement de l’IA s’arrêtait aujourd’hui, les effets déjà enclenchés transformeraient l’économie pendant des années Mais au-delà des projections spectaculaires ou des discours sceptiques, un fait s’impose : les modèles actuels sont déjà fascinants.

Et leur fonctionnement réserve une surprise.

Les machines apprennent vraiment

La première leçon paraît simple : les machines apprennent. Contrairement à la programmation classique — où l’on définit explicitement les règles — l’apprentissage automatique fonctionne à l’inverse. On fournit des exemples, et le système déduit les régularités.

Un modèle de langage est un réseau composé de milliards de paramètres ajustés progressivement. Chaque erreur modifie légèrement ces paramètres. Le processus est long, opaque par son ampleur, mais strictement mathématique.

Le domaine a retenu une idée devenue célèbre la “bitter lesson”. Pendant des décennies, les chercheurs ont tenté d’injecter leur savoir dans les machines. Ce qui a finalement fonctionné, ce n’est pas d’écrire les règles à la main, mais de créer les conditions pour qu’elles émergent d’elles-mêmes.

Des capacités émergentes

Un modèle de langage est initialement entraîné sur une tâche simple : prédire le mot suivant. Pourtant, cette tâche minimale révèle une puissance inattendue.

Pour prédire correctement un mot, il faut comprendre le contexte, les concepts, parfois même les intentions implicites.

Compléter une phrase sur la hauteur du Kilimandjaro en pièces de monnaie exige des connaissances géographiques et mathématiques. Deviner comment réagir à la mort d’un chien suppose une compréhension sociale élémentaire.

Ce qui semblait être un exercice linguistique étroit devient un entraînement généraliste. À grande échelle, la prédiction du mot suivant force le modèle à internaliser des structures complexes du monde.

L’émergence n’est pas un miracle : c’est le produit de répétitions astronomiques d’un mécanisme simple.

Une “évolution imparfaite”

L’apprentissage des IA ne ressemble pas à celui d’un enfant. Un humain apprend avec peu d’exemples et une architecture cognitive pré-configurée. Les modèles, eux, partent presque de zéro et consomment d’immenses volumes de données. La métaphore la plus pertinente n’est peut-être pas l’enfance, mais l’évolution. Un processus lent, aveugle, fait d’innombrables ajustements minuscules. De cette accumulation émergent des capacités robustes, mais aussi des imperfections.

C’est un apprentissage massif, statistique, parfois chaotique — mais étonnamment efficace.

Automatisation cognitive

François Chollet préfère parler “d’automatisation cognitive” plutôt que d’intelligence complète. Selon lui, les modèles actuels manquent d’autonomie cognitive : la capacité d’affronter l’inédit avec adaptabilité.

Il est vrai que les premiers modèles commettaient des erreurs élémentaires. Pourtant, des avancées récentes modifient la situation. L’apprentissage par renforcement, par exemple, permet aux modèles de s’améliorer à partir de leurs propres tentatives, en sélectionnant les réponses les plus performantes. Les modèles dits “raisonnants” génèrent désormais des étapes intermédiaires avant de répondre. Ils simulent une forme de réflexion structurée. Ce n’est pas une pensée consciente, mais ce n’est plus une simple mémorisation brute.

Le débat reste ouvert : s’agit-il d’intelligence authentique ou d’une imitation sophistiquée ? Certains chercheurs estiment que la capacité de généralisation observée dépasse ce que l’on peut réduire à un simple stockage d’exemples.

Une intelligence plus intuitive que logique

Le paradoxe est là. On imaginait les machines comme des entités froides, purement rationnelles. Or les modèles actuels fonctionnent davantage comme notre “Système 1” pour reprendre Daniel Kahneman rapide, intuitif, basé sur des patterns.

Ils produisent du style, détectent des tonalités, répondent avec fluidité — souvent sans pouvoir expliquer leur raisonnement interne.

En revanche, le calcul rigoureux et la logique délibérée furent longtemps leurs points faibles.

Les recherches récentes visent justement à construire une forme artificielle de “Système 2” raisonnement étape par étape, outils externes, vérification mathématique. Les progrès sont visibles, notamment en résolution de problèmes complexes.

Mais la base reste intuitive : une immense reconnaissance de motifs.

Et si nous étions aussi des motifs ?

Observer l’IA interroger nos propres capacités. Si une machine peut écrire, traduire, composer ou coder par reconnaissance de patterns à grande échelle, quelle part de nos compétences repose sur des mécanismes similaires ?

L’histoire des sciences a souvent réduit notre sentiment d’exception. L’IA ajoute une couche supplémentaire : certaines facultés que nous pensions exclusivement humaines semblent émerger d’un traitement statistique suffisamment vaste.

Cela ne signifie pas que tout se réduit à des statistiques. Mais cela force à reconsidérer la frontière.

Une explosion comparable au Cambrien

Les systèmes actuels ont encore des limites claires : manque d’apprentissage continu, compréhension partielle du monde physique, fragilité dans certains contextes.

Pourtant, une formule fonctionne désormais réseaux puissants, données massives, calcul intensif.

Nous vivons une période d’explosion comparable, métaphoriquement, au Cambrien une prolifération rapide d’approches, de laboratoires, d’expérimentations. Certains explorent des systèmes adaptatifs, d’autres des modèles capables d’interagir avec le monde réel, d’autres encore des architectures capables d’écrire leurs propres programmes.

Personne ne sait jusqu’où cela ira. Mais une chose est certaine : des algorithmes apprennent déjà à lire, écrire, programmer et raisonner — parfois maladroitement, parfois de manière stupéfiante.

Et cela, en soi, est déjà un événement historique.